Los sistemas autónomos de IA, como los coches autónomos, los drones de reparto o los robots industriales, funcionan sin supervisión humana directa. Los ingenieros agregan un radar de ondas milimétricas (mmWave) a estos sistemas porque mide objetos, distancia y velocidad, incluso en niebla, lluvia o polvo. El radar mejora la conciencia del sistema, pero también introduce nuevos puntos donde pueden producirse ataques o fallos. Las organizaciones utilizan red-teaming para simular ataques y probar estos sistemas. El equipo rojo ayuda a encontrar debilidades antes de que provoquen accidentes, pérdidas financieras o fallas operativas.

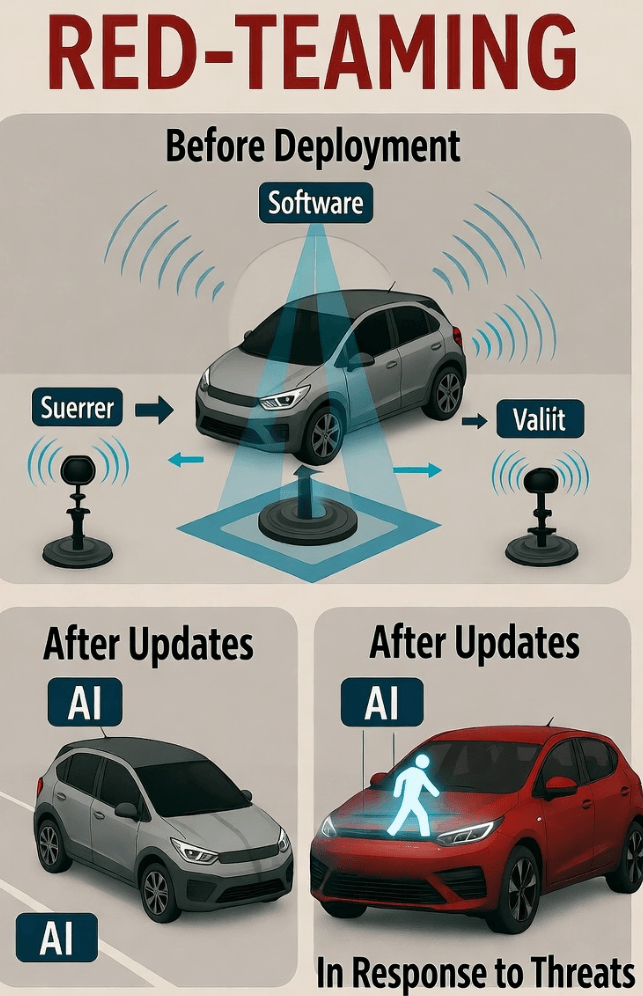

El equipo rojo es más crítico en tres momentos: antes de la implementación, después de actualizaciones importantes o cambios ambientales, y después de incidentes o amenazas emergentes. La combinación de pruebas de IA con escenarios específicos de radar garantiza que los sistemas funcionen de forma segura y confiable.

Antes de la implementación o lanzamiento público

Las empresas deben garantizar que la IA y los sensores de radar funcionen juntos correctamente antes de su uso público. Si bien el radar mmWave puede detectar objetos en muchas condiciones, los atacantes pueden engañarlo o bloquear sus señales.

Comprensión de las debilidades del radar

Un vehículo autónomo podría confundir una lámina de metal reflectante del radar con un obstáculo real. El coche podría frenar bruscamente o desviarse inesperadamente. Un dron podría navegar incorrectamente si las señales de radiofrecuencia interfieren con el radar. Estos errores pueden ocurrir incluso cuando el modelo de IA parece correcto en condiciones de prueba normales.

Enfoques de equipo rojo

Los equipos pueden simular tales riesgos combinando señales de radar manipuladas con entradas de IA adversarias. Pueden probar escenarios inusuales, como obstáculos en movimiento o interferencias ambientales. Los ingenieros, especialistas en seguridad y especialistas en ética que trabajan juntos pueden observar cómo reacciona el sistema en situaciones complejas. El equipo rojo en esta etapa ayuda a las organizaciones a solucionar problemas antes de permitir que el sistema llegue al uso público, lo que reduce el riesgo de accidentes o retiros costosos.

Después de actualizaciones o cambios ambientales importantes

Los sistemas autónomos de IA evolucionan con el tiempo. Actualizaciones como agregar sensores de radar de mayor resolución, mejorar los algoritmos de procesamiento de señales o ampliar las áreas operativas pueden introducir nuevos riesgos. Por ejemplo, un automóvil equipado con un radar nuevo podría malinterpretar pequeños obstáculos si la IA no fuera reentrenada. Las nuevas calles urbanas o patrones de tráfico pueden exponer puntos ciegos del radar.

Estrategias de equipo rojo después de las actualizaciones

El equipo rojo después de las actualizaciones debe centrarse en componentes alterados en condiciones realistas. Los equipos simulan objetos reflectantes, interferencias de radio o sensores bloqueados. También prueban escenarios como lluvias intensas, reflejos de múltiples trayectorias u oclusión temporal del sensor. Observar cómo las decisiones de la IA interactúan con las entradas del radar garantiza que las actualizaciones no creen debilidades ocultas.

Beneficios de las pruebas posteriores a la actualización

Red-teaming posterior a la actualización proporciona comentarios que ayudan a mejorar la calibración del sensor, los modelos de IA y la lógica de toma de decisiones. Crea un circuito de retroalimentación: las pruebas revelan fallas, los ingenieros las corrigen y el sistema se vuelve más seguro y confiable.

Después de incidentes o amenazas emergentes

Las amenazas emergentes, como la interferencia de radar, la suplantación de identidad o los ataques adversarios de IA, exigen atención inmediata. Por ejemplo, un dron equipado con un radar podría desviarse de su rumbo debido a falsos reflejos. Podría ocurrir un casi accidente si el radar percibe mal un obstáculo y la IA juzga mal la respuesta.

Respuesta del equipo rojo a incidentes

Los equipos pueden recrear incidentes en un entorno controlado manipulando señales de radar y entradas de IA. También deben monitorear las tendencias de la industria y los nuevos métodos de ataque, por ejemplo usando el marco MITRE ATLAS. Las pruebas periódicas, como cada tres meses para los sistemas de alto riesgo, ayudan a mantener la resiliencia del sistema. Seguir estándares como ISO/SAE 21434 garantiza que los sistemas de radar y de inteligencia artificial cumplan con los requisitos de seguridad y ciberseguridad.

Aprendiendo de los incidentes

El equipo rojo después de los incidentes mejora la comprensión de los riesgos del mundo real. Los equipos analizan registros, miden los tiempos de respuesta y ven cómo interactúan la IA y el radar. Las lecciones de estas pruebas guían las actualizaciones de software y el diseño de hardware, lo que reduce la posibilidad de errores repetidos.

Prácticas recomendadas para la IA mejorada con radar de equipo rojo

Usar múltiples escenarios

Los equipos deben probar juntos los desafíos físicos, digitales y ambientales para descubrir debilidades ocultas.

Colaboración multifuncional

Incluir ingenieros, expertos en seguridad, especialistas en ética y operadores de sistemas proporciona diferentes perspectivas que mejoran la calidad de las pruebas.

Pruebas en diferentes niveles

El equipo rojo debe cubrir pruebas de IA a nivel de unidad, pruebas de radar a nivel de sistema y pruebas de integración completa.

Documentación y pruebas periódicas

Los equipos deben documentar los hallazgos, las correcciones y las lecciones aprendidas. Las pruebas continuas son necesarias porque los riesgos evolucionan con las actualizaciones y las nuevas amenazas.

Pensamientos finales

La integración del radar mmWave con sistemas autónomos de IA ofrece beneficios mensurables: percepción mejorada, mejor toma de decisiones y seguridad operativa. Pero también requiere una cuidadosa formación de equipos en momentos clave (antes de la implementación, después de las actualizaciones y después de los incidentes) para descubrir vulnerabilidades, validar las actualizaciones del sistema y abordar nuevas amenazas.

Al combinar el equipo rojo de IA con pruebas específicas de radar, las organizaciones pueden desarrollar sistemas autónomos que no solo sean inteligentes sino también resistentes y confiables. El monitoreo continuo, las pruebas y las estrategias de defensa proactiva garantizan que estos sistemas funcionen de manera segura y confiable en condiciones del mundo real.

Para obtener orientación práctica, puede explorar las aplicaciones de radar Linpowave o consultar Secure My ORG para servicios de ciberseguridad y red teaming.

Preguntas frecuentes: IA autónoma de equipo rojo con radar mmWave

P1: ¿Qué es el radar mmWave y por qué usarlo?

R: El radar mmWave envía ondas de alta frecuencia para medir objetos, distancia y velocidad. Funciona bajo lluvia, niebla, poca luz o polvo. Usarlo con IA mejora el conocimiento de la situación para automóviles, drones y robots.

P2: ¿Cómo se puede atacar el radar?

R: Los atacantes pueden utilizar superficies reflectantes, interferencias de radio u objetos de bloqueo para engañar al radar. Estos ataques pueden hacer que la IA vea obstáculos falsos o pase por alto los reales.

P3: ¿Qué es el equipo rojo específico de radar?

R: El equipo rojo específico de radar prueba los sistemas de IA bajo fallas de radar simuladas. Los equipos pueden simular objetos en movimiento o reflectantes, introducir señales de interferencia o combinar ataques de radar con manipulaciones de entrada de IA.

P4: ¿Con qué frecuencia debe realizarse el equipo rojo?

R: Las organizaciones deben realizar pruebas antes de la implementación, después de actualizaciones importantes y después de incidentes o nuevas amenazas. Los sistemas en dominios de alto riesgo deben realizar equipos rojos cada tres meses.

P5: ¿Qué estándares o herramientas respaldan la formación de equipos rojos para sistemas de IA equipados con radar?

R: Los estándares y herramientas útiles incluyen marco MITRE ATLAS y ISO/SAE21434 para ciberseguridad automotriz.

P6: ¿Puede el equipo rojo eliminar todos los riesgos?

R: No. El equipo rojo identifica puntos débiles y fortalece los sistemas, pero las organizaciones deben continuar monitoreando, probando y mejorando las defensas para manejar nuevas amenazas.